Το παιχνίδι των ψευδών ειδήσεων ανεβαίνει επίπεδο (pics+vid)

Το πέρασµα στην εποχή των «deepfakes» κάνει πολλούς να... αναπολούν τις µέρες των «fake news»🕛 χρόνος ανάγνωσης: 7 λεπτά ┋

Εάν με την διάδοση ψευδών ειδήσεων µπορούν να επηρεαστούν προεκλογικές εκστρατείες ή να επικρατήσει σύγχυση στην κοινή γνώµη, φανταστείτε τι µπορεί να προκαλέσει ένα πλαστό µεν, αλλά πειστικό βίντεο µε έναν ηγέτη να κάνει εµπρηστικά σχόλια την παραµονή των εκλογών σε ένα υποτιθέµενο διάγγελµα, µε έναν στρατιώτη να εµφανίζεται να δολοφονεί αµάχους, µε τον αρχηγό της Αστυνοµίας να κάνει ρατσιστικά σχόλια εναντίον των µεταναστών ή τον «πλανητάρχη» να ανακοινώνει στους συµβούλους του ότι θα επιτεθεί µε πυρηνικά όπλα εναντίον µιας υπερδύναµης.

Τίποτα από αυτά δεν έχει συµβεί, πλην όµως υπάρχει ένα «αποδεικτικό» βίντεο για καθεµία από αυτές τις περιπτώσεις. Η τεχνητή νοηµοσύνη τροφοδοτεί την επόµενη πιο τροµακτική φάση παραπληροφόρησης, µε την τρέχουσα εποχή των «fake news» να δίνει σιγά σιγά τη θέση της στην εποχή των λεγόµενων «deepfakes», των ψεύτικων βίντεο µε πρωταγωνιστές πρόσωπα που φαίνονται να λένε ή να κάνουν πράγµατα που δεν έχουν πει ή κάνει ποτέ. Με τη χρήση τεχνικών εκµάθησης µηχανών (GAN) αλλά και εύχρηστων -πλέον- εφαρµογών, οποιοσδήποτε στον πλανήτη µπορεί θεωρητικά να «πλαστογραφήσει» οπτικοακουστικό υλικό µε τρόπο ώστε να δείχνει κάποιον να λέει ή να πράττει ό,τι µπορεί να φανταστεί κανείς.

Παρόλο που οι πρώτες εφαρµογές αυτής της µεθόδου είχαν ως στόχο να δυσφηµήσουν διασηµότητες, όπως η ηθοποιός Εµα Γουότσον ή η τραγουδίστρια Κέιτι Πέρι, µε την τοποθέτηση των κεφαλιών τους πάνω σε σώµατα πρωταγωνιστών... πορνογραφικών ταινιών, τα «fake» βίντεο µπορούν να αποδειχθούν πολύ πιο επικίνδυνα για την πολιτική και τη δηµόσια ασφάλεια.

Επί του πρακτέου

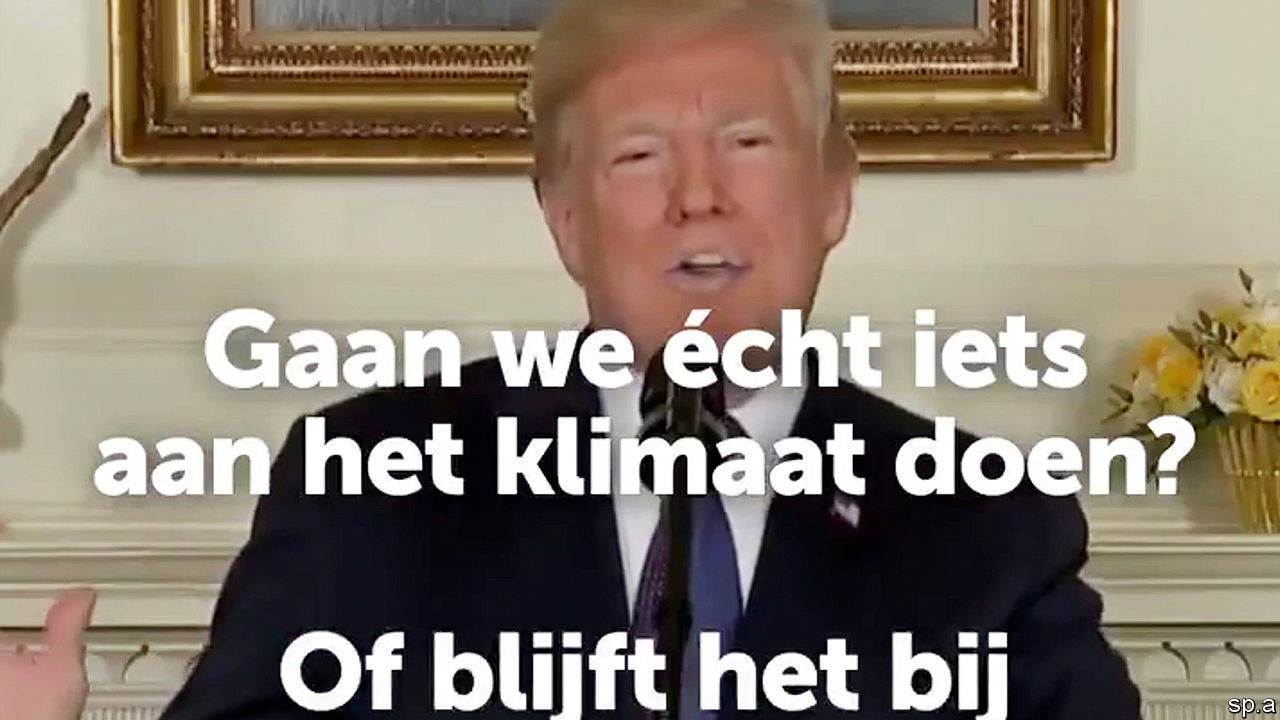

Η δύναµη των πλαστών βίντεο φαίνεται µε ξεκάθαρο τρόπο στην καµπάνια που έκανε το βελγικό κόµµα sp.a για την κλιµατική αλλαγή. Τον περασµένο Μάιο κυκλοφόρησε στο ∆ιαδίκτυο ένα βίντεο στο οποίο είχε τοποθετήσει ένα ψεύτικο στόµα στον Ντόναλντ Τραµπ που ζητούσε από το Βέλγιο -µε φωνή που θύµιζε εκείνη του Αµερικανού προέδρου- να αποσυρθεί από τη Συµφωνία του Παρισιού για το κλίµα. Πρόθεση του αριστερού κόµµατος ήταν να ευαισθητοποιήσει την κοινή γνώµη για το ζήτηµα της κλιµατικής αλλαγής και παρά την εµφανώς κακή ποιότητα του ήχου και της εικόνας του τελικού βίντεο, που το sp.a πίστευε ότι θα φανέρωνε την πλαστότητά του, και µόνο η ύπαρξή του ήταν αρκετή για να πείσει τους χρήστες και να προκαλέσει οργισµένες αντιδράσεις κατά του Τραµπ για την υποτιθέµενη έκκλησή του.

Όµως η τεχνολογία των «deepfakes» βελτιώνεται µε γοργούς ρυθµούς και ήδη έχουν κάνει την εµφάνισή τους βίντεο που επιδεικνύουν τις ασύλληπτες δυνατότητες των δικτύων GAN. Σε πολλές περιπτώσεις είναι αδύνατον για έναν χρήστη να ξεχωρίσει το αληθινό από το πλαστό βίντεο µε «γυµνό µάτι». Η διαδικασία «πλαστογράφησης» γίνεται ως εξής: αρχικά κάποιος που θέλει να παραποιήσει ένα βίντεο, για παράδειγµα του Μπαράκ Οµπάµα, «εκπαιδεύει» έναν αλγόριθµο πάνω στον πρώην πρόεδρο των ΗΠΑ, δείχνοντάς του πολλές πραγµατικές εικόνες του, στις οποίος εκείνος µιλάει, µορφάζει και κινείται.

Στη συνέχεια χρησιµοποιεί ως «πηγή» κάποιον φίλο του τον οποίο καταγράφει να κάνει µια ψεύτικη δήλωση, λαµβάνοντας υπόψη όχι µόνο τα λόγια του αλλά και τους µορφασµούς και τις χειρονοµίες του. Στο τέλος ο αλγόριθµος πλαστογραφεί (ακόµα και σε πραγµατικό χρόνο!) ένα υπαρκτό βίντεο του διάσηµου Οµπάµα, µε τέτοιον τρόπο ώστε να αντιγράφει πιστά τα λόγια και όλους τους µορφασµούς της «πηγής» και µάλιστα µε την πραγµατική φωνή του πρώην πλανητάρχη.

Με µια διαφορετική µορφή (πιθανής) παραποίησης έκανε την εµφάνισή του τις προηγούµενες ηµέρες ένα βίντεο από τον διαπληκτισµό του προέδρου Τραµπ µε τον δηµοσιογράφο του CNN Τζιµ Ακόστα. Τραβηγµένο από το πλάι, το βίντεο εµφάνιζε τον Ακόστα να σπρώχνει το χέρι της βοηθού του Τραµπ που πήγε να του αποσπάσει το µικρόφωνο κατά τη διάρκεια συνέντευξης Τύπου. Το υλικό χρησιµοποιήθηκε από τον Λευκό Οίκο για να δικαιολογήσει την αφαίρεση της διαπίστευσης του δηµοσιογράφου, ωστόσο αργότερα φάνηκε ότι το βίντεο είχε κάποια καρέ... «πειραγµένα» και εµφάνιζε ψευδώς τον Ακόστα να απλώνει χέρι στην υπάλληλο.

Προς το παρόν τα «deepfakes» δεν έχουν εξελιχθεί τόσο ώστε να καθιστούν αδύνατη την εξακρίβωση της αυθεντικότητας µέσω της τεχνολογίας (η εφηµερίδα «Wall Street Journal» ανακοίνωσε πρόσφατα τη σύσταση οµάδας για τον εντοπισµό των «deepfakes»), ωστόσο υπάρχουν περιπτώσεις στις οποίες ο χρόνος µπορεί να µην είναι αρκετός για την αποκατάσταση της αλήθειας. Τέτοια παραδείγµατα θα ήταν µια ψεύτικη δήλωση την παραµονή των εκλογών ή µια εµπρηστική δήλωση που µπορεί µέσα σε λίγες ώρες να προκαλέσει ταραχές σε µια περιοχή ή να ωθήσει εξτρεµιστικές οµάδες στη βία.

Τα «deepfakes» θα µπορούσαν να χειραγωγήσουν, να τινάξουν στον αέρα τη δηµοκρατία και να απειλήσουν την εθνική ασφάλεια ή τις γεωπολιτικές ισορροπίες. Παρά τους προφανείς κινδύνους για τη δηµοκρατία και τον τρόπο που αντιλαµβανόµαστε τον κόσµο γύρω µας, η τεχνολογία των «deepfakes» µπορεί ωστόσο να φέρει εντυπωσιακά αποτελέσµατα στον κλάδο της ψυχαγωγίας, «λύνοντας» τα χέρια των τηλεοπτικών και κινηµατογραφικών παραγωγών. Η δυνατότητα πειστικής αλλοίωσης της φωνής, των κινήσεων και των µορφασµών των πρωταγωνιστών µπορεί να ρίξει δραµατικά το κόστος των παραγωγών και να βελτιώσει µε το πάτηµα ενός κουµπιού λάθη που έγιναν στη διάρκεια των γυρισµάτων.

Κρυπτομηνύματα

Ο νόµος του Λιντς µε τη σφραγίδα του WhatsApp

Στις 26 Οκτωβρίου του 2018 ένας άνδρας δολοφονήθηκε στην Μπογκοτά από µια κολοµβιανή συµµορία, έπειτα από την κυκλοφορία ενός ψευδούς µηνύµατος στο WhatsApp που τον κατηγορούσε για την απαγωγή ενός παιδιού. ∆έκα ηµέρες νωρίτερα, στο Εκουαδόρ, δύο άνδρες και µία γυναίκα συνελήφθησαν από την Αστυνοµία για την κλοπή ενός ποσού δολαρίων, αλλά όταν αφέθηκαν ελεύθεροι, µια συµµορία τούς δολοφόνησε έπειτα από τη διάδοση ενός µηνύµατος στην πλατφόρµα WhatsApp που τους χαρακτήριζε απαγωγείς παιδιών. Αντίστοιχη ήταν η τύχη δύο νεαρών στη µικρή πόλη Ακατλάν του Μεξικού, όπου συνελήφθησαν για ένα πταίσµα και όταν βγήκαν από το αστυνοµικό τµήµα, βρήκαν µπροστά τους ένα εξαγριωµένο πλήθος.

Και στην περίπτωσή τους ένα µήνυµα που διαδόθηκε γρήγορα στην τοπική κοινωνία µέσω WhatsApp και τους κατηγορούσε για τις απαγωγές τριών παιδιών εξόργισε πολλούς πολίτες, που -µε την παρότρυνση µιας συµµορίας- τους ξυλοκόπησαν µέχρι θανάτου και στη συνέχεια τους έλουσαν µε πετρέλαιο και έβαλαν φωτιά στα σώµατά τους. Τα λιντσαρίσµατα που οφείλονται σε «fake news» που διασπείρονται µέσω της υπηρεσίας ανταλλαγής κρυπτογραφηµένων µηνυµάτων έχουν λάβει τεράστιες διαστάσεις σε µια σειρά από χώρες, µε τις περισσότερες περιπτώσεις να καταγράφονται στο Μεξικό και στην Ινδία.

Με τη βοήθεια της πλατφόρµας που έχει εξαγοράσει το Facebook οι φήµες που οδηγούν σε βίαιους θανάτους διαδίδονται ταχύτατα, ενώ η κρυπτογράφηση διασφαλίζει την ανωνυµία της πηγής του µηνύµατος. «Πιστεύουµε ότι για κάθε δέκα εγκλήµατα η εν λόγω τεχνολογία χρησιµοποιείται στα εννέα» έχει αναφέρει χαρακτηριστικά στο BBC ο υφυπουργός Πληροφοριών της Πόλης του Μεξικού, Χοσέ Τζιλ. Παρά την εξάπλωση του φαινοµένου και τις δραµατικές εκκλήσεις των κυβερνήσεων, το WhatsApp έχει αρνηθεί να άρει την κρυπτογράφηση, ωστόσο προέβη στα εξής µέτρα: προσέθεσε µία ένδειξη προωθηµένου µηνύµατος και περιόρισε των αριθµό ατόµων στα οποία µπορεί να προωθηθεί ένα µήνυµα στα πέντε για την Ινδία και στα 20 για τον υπόλοιπο κόσµο.

Τι ποσοστό θέλει στις ευρωεκλογές ο Μητσοτάκης και σε ποια κόμματα της αντιπολίτευσης εξαπέλυσε «πυρά»

Υψη κτιρίων: Πυροσβεστική τροπολογία για τις αντιδράσεις - «Δε λύνει το πρόβλημα», λένε οι δήμαρχοι

Ελευσίνα: Τροχαίο με 31χρονο νεκρό - Ένας σοβαρά τραυματίας

Πασχαλινή έξοδος από … χρυσάφι: Στα ύψη οι τιμές, βενζίνης, διοδίων και εισιτηρίων

Live όλες οι εξελίξεις λεπτό προς λεπτό, με την υπογραφή του www.ethnos.gr